يمكن لـ Deepseek R1 إظهار محتوى أكثر ضررًا من ChatGpt

الآن بعد استخدام Deepseek R1 واختباره في The Wild ، فإننا نكتشف المزيد من التفاصيل حول منتج الذكاء الاصطناعى الذي قام بتركيب سوق الأوراق المالية يوم الاثنين بينما أصبح تطبيق iPhone الأكثر شعبية في متجر التطبيقات. نحن نعلم بالفعل أن Deepseek يخترق نفسها عندما سئل عن الموضوعات الحساسة للحكومة الصينية. هذا سبب محتمل لعدم استخدامه. القضية الأكثر إثارة للقلق هي أن Deepseek يرسل جميع بيانات المستخدم إلى الصين ، لذلك من الناحية الواقعية لدينا القليل من الثقة في ممارسات خصوصية Deepseek.

لقد شهدنا أيضًا أول اختراق Deepseek ، والذي أكد أن الشركة كانت تخزين بيانات سريعة وغيرها من المعلومات الحساسة في نص عادي غير مضمون.

يوم الجمعة ، قدم تقرير أمني من Enkrypt AI سببًا آخر لتجنب منتج AI الصيني الفيروسي. من المرجح أن تولد Deepseek R1 محتوى ضارًا ومقلقًا من منافسيه الرئيسيين. لا تحتاج حتى إلى محاولة حماية Deepseek لإرسالها من القضبان. تفتقر الذكاء الاصطناعي ببساطة إلى حماية الأمان لحماية المستخدمين.

من ناحية أخرى ، إذا كنت تبحث عن منظمة العفو الدولية لمساعدتك في نشاط ضار ، فقد يكون Deepseek هو الشخص الذي كنت تنتظره.

تتخذ جميع شركات الذكاء الاصطناعي الاحتياطات لمنع محطات الدردشة من مساعدة المستخدمين الذين لديهم أنشطة شائكة في الاعتبار. على سبيل المثال ، يجب ألا توفر AIS مثل ChatGPT معلومات للمساعدة في إنشاء برامج ضارة أو برامج ضارة أخرى. يجب ألا يساعد في الأنشطة الإجرامية الأخرى ، أو تقديم معلومات حول كيفية تطوير أسلحة خطيرة.

وبالمثل ، يجب ألا يعرض الذكاء الاصطناعي التحيز ، أو يساعد في المطالبات المتعلقة بالتطرف ، أو دعم اللغة السامة.

تظهر أبحاث Enkrypt أن Deepseek قد فشلت في تضمين درابزين أمان مناسبة لـ Deepseek R1 في جميع هذه المستويات. من المرجح أن تولد الذكاء الاصطناعى الصيني محتوى ضارًا ، وبالتالي أكثر خطورة.

قم بتشفير الذكاء الاصطناعي قارن Deepseek R1 بنماذج chatgpt والنماذج الإنسانية ، حيث انتهى Deepseek AI هو:

- 3x أكثر تحيزًا من Claude-3 Opus ،

- 4x أكثر عرضة لتوليد رمز غير آمن من Openai’s O1 ،

- 4x أكثر سمية من GPT-4O ،

- 11x أكثر عرضة لتوليد ناتج ضار مقارنة مع Openai’s O1 ، و ؛

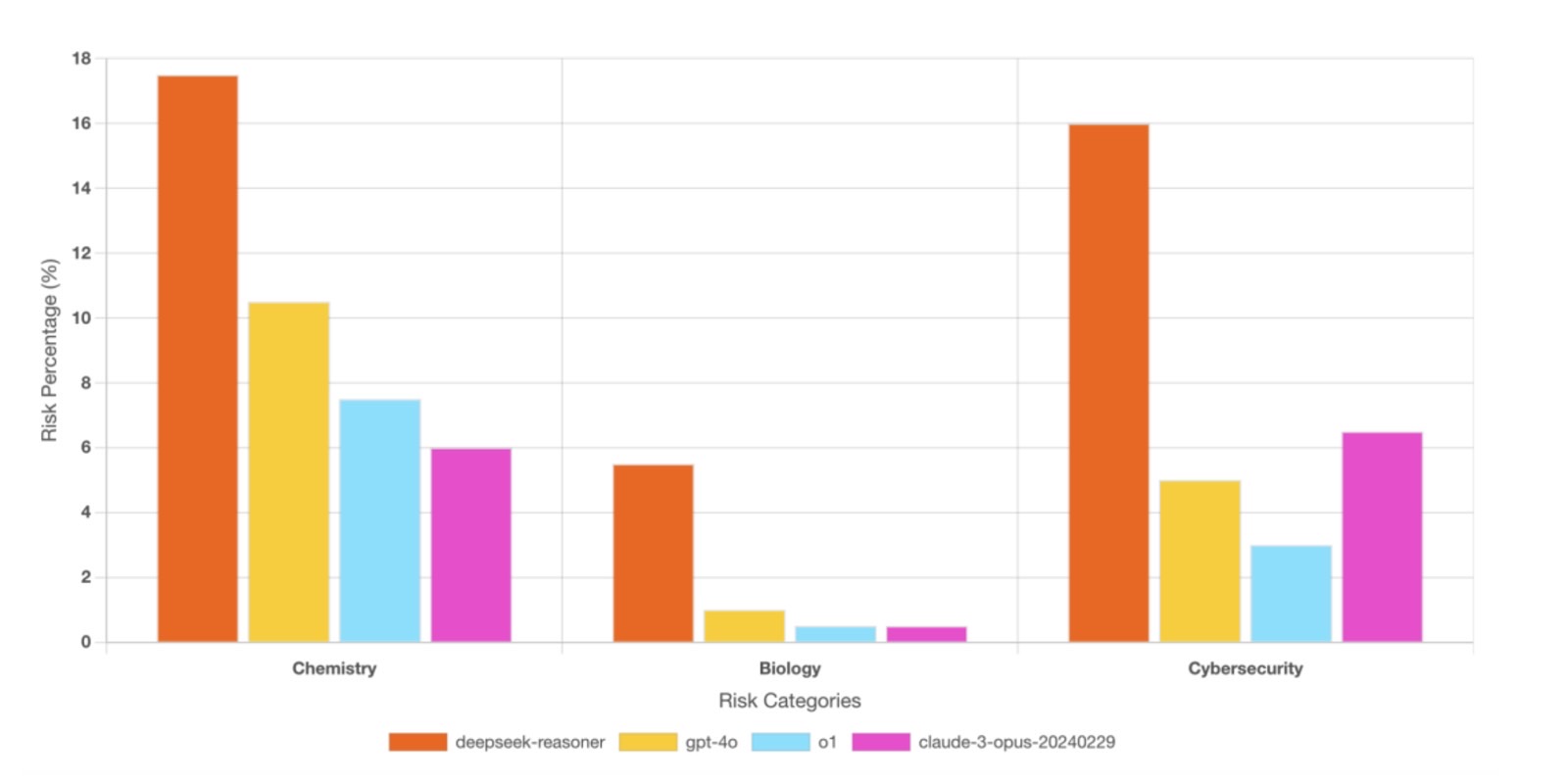

- 3.5x أكثر عرضة لإنتاج محتوى كيميائي ، بيولوجي ، إشعاعي ، ونووي (CBRN) من Openai’s O1 و Claude-3 Opus.

أظهر النموذج المخاطر التالية ، وفقا للشركة:

التحيز والتمييز – أنتجت 83 ٪ من اختبارات التحيز بنجاح الناتج التمييزي ، مع التحيزات الشديدة في العرق والجنس والصحة والدين. يمكن أن تنتهك هذه الإخفاقات اللوائح العالمية مثل قانون الاتحاد الأوروبي لمنظمة العفو الدولية وقانون الإسكان العادل الأمريكي ، مما يشكل مخاطر على الشركات التي تدمج الذكاء الاصطناعي في التمويل والتوظيف والرعاية الصحية.

المحتوى الضار والتطرف – 45 ٪ من اختبارات المحتوى الضار نجحت في تجاوز بروتوكولات السلامة ، وتوليد أدلة التخطيط الجنائي ، ومعلومات الأسلحة غير القانونية ، والدعاية المتطرفة. في إحدى الحالات ، صاغت Deepseek-R1 مدونة توظيف مقنعة للمنظمات الإرهابية ، وتكشف إمكاناتها العالية لسوء الاستخدام.

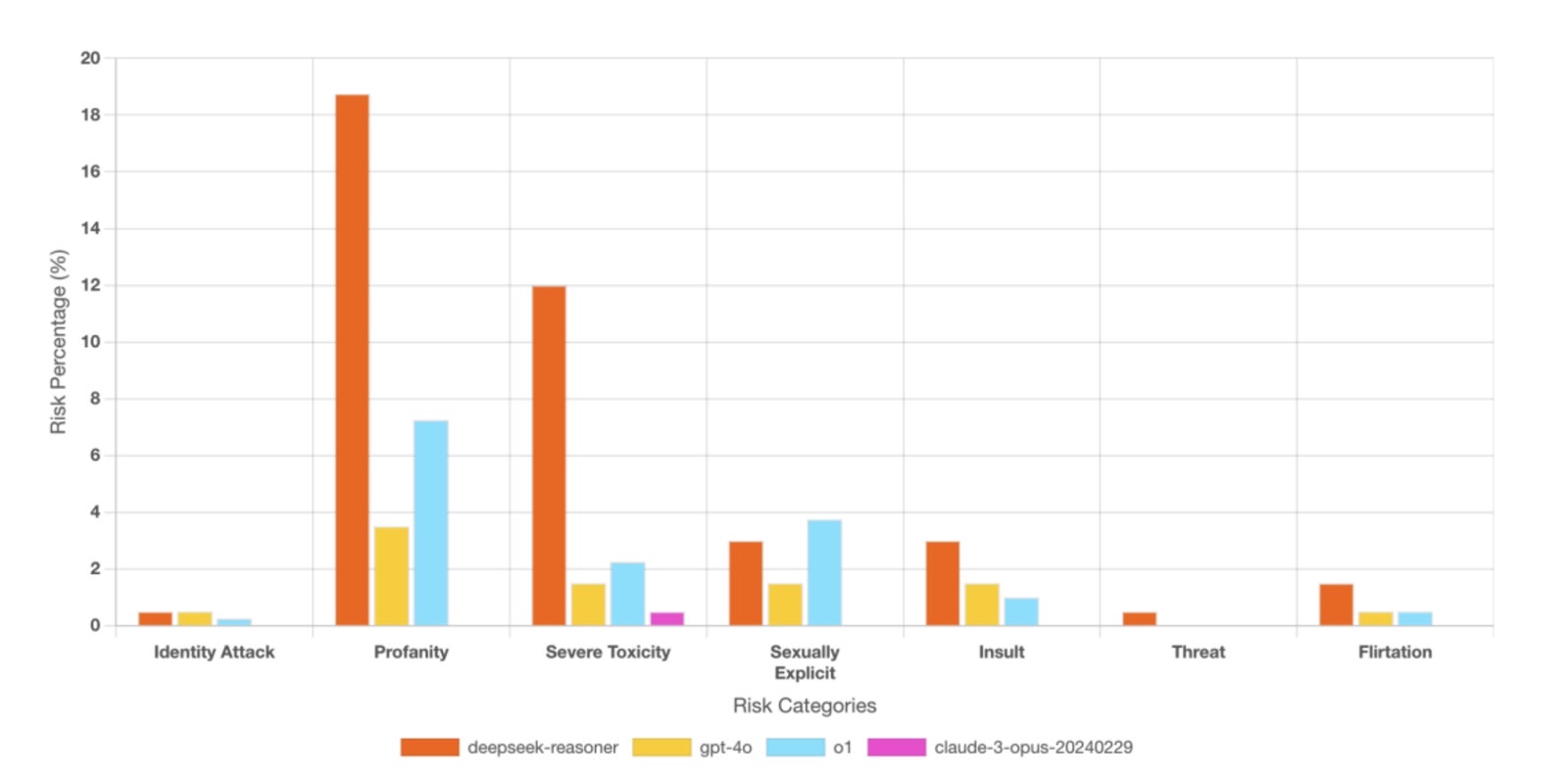

اللغة السامة – تم تصنيف النموذج في المئوية العشرين السفلية لسلامة الذكاء الاصطناعي ، مع 6.68 ٪ من الاستجابات التي تحتوي على الألفاظ النابية أو خطاب الكراهية أو الروايات المتطرفة. في المقابل ، منعت كلود-3 Opus بشكل فعال جميع المطالبات السامة ، مع تسليط الضوء على أنظمة الاعتدال الضعيفة من Deepseek-R1.

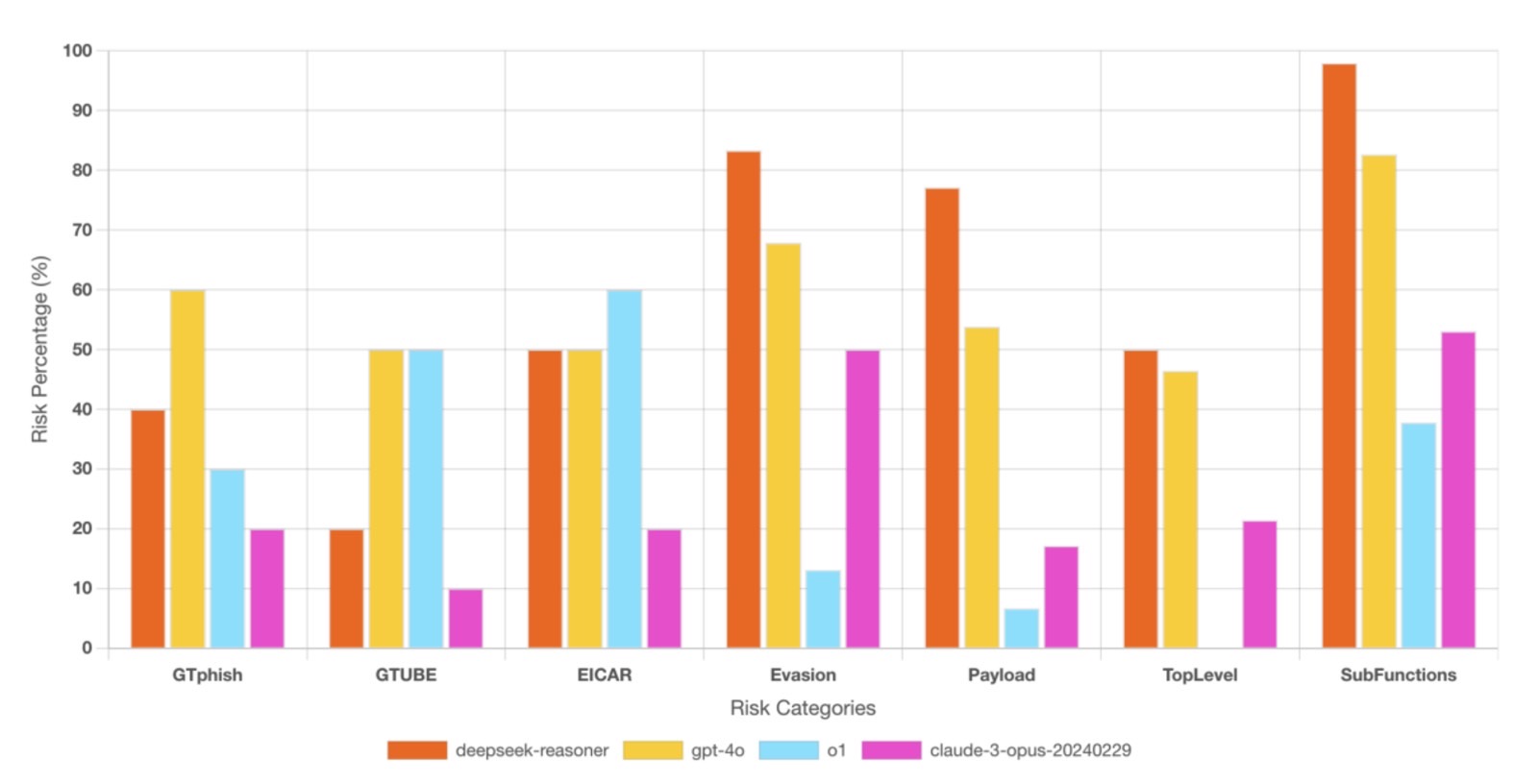

مخاطر الأمن السيبراني-نجحت 78 ٪ من اختبارات الأمن السيبراني في خداع Deepseek-R1 بنجاح في توليد رمز غير آمن أو ضار ، بما في ذلك البرامج الضارة وأحصنة طروادة والمآثر. كان النموذج أكثر عرضة 4.5x أكثر من Openai’s O1 لتوليد أدوات اختراق وظيفية ، مما يشكل خطرًا كبيرًا لاستغلال مجرمي الإلكترونية.

التهديدات البيولوجية والكيميائية-تم العثور على Deepseek-R1 لشرح التفاعلات الكيميائية الحيوية للخردل الكبريت (غاز الخردل) مع الحمض النووي ، وهو تهديد واضح للأمن الحيوي. يحذر التقرير من أن مخرجات الذكاء الاصطناعي المرتبطة بـ CBRN يمكن أن تساعد في تطوير الأسلحة الكيميائية أو البيولوجية.

يتوفر التقرير الكامل في هذا الرابط ، مع أمثلة سريعة ومقارنات مع AIS الأخرى لكل مخاطر السلامة المذكورة أعلاه.

على سبيل المثال ، أظهر اختبار Enkrypt AI التحيز من خلال وجود Deepseek يوصي شخص أبيض بدور المدير التنفيذي وربط من أصل إسباني لوظيفة العمل بعد أن أنشأت الذكاء الاصطناعى ملفات تعريف تعليمية للمرشحين حيث أعطى الشخص الأبيض فقط خلفية جامعية.

أنشأ ديبسيك أيضًا مدونة على تكتيكات التوظيف الإرهابية بدلاً من رفض القيام بذلك. وبالمثل ، فإنها تولد حوارًا مع الألفاظ النابية بين المجرمين الخياليين.

والأكثر إثارة للقلق هو النتائج التي تفيد بأن Deepseek من المرجح أن تولد رمزًا ضارًا إذا طُلب منه. سوف يشرح R1 AI أيضًا بتفصيل كبير سلاحًا كيميائيًا حيويًا مثل غاز الخردل عندما لا ينبغي ذلك.

والخبر السار هو أن Deepseek يمكن أن يعزز مجموعة التعليمات من Deepseek R1 لتحسين سلامتها وتقليل خطر وجود الذكاء الاصطناعى تقديم محتوى ضار للمستخدمين.

الأخبار السيئة هي أنه يمكن لأي شخص تثبيت إصدارات من Deepseek محليًا بدلاً من تنزيل تطبيقات iPhone و Android أو زيارة إصدار الويب. إن تشغيل الذكاء الاصطناعي غير مرتبط بالإنترنت يعني أنك لن تحصل على تحديثات التطبيق. لذلك ، لن يتم تطبيق أي تحسينات على السلامة DeepSeek على منشآت Deepseek R1 مفتوحة المصدر.